今週グーグルそのウェブサイトから構築しないというコミットメントを削除しました武器または監視のための人工知能。この変更は、ブルームバーグによって初めて気づかれました。

会社は彼を更新したようですAIの原則に関するパブリックページ、先週まだ存在していた「追求しないアプリケーション」セクションを削除します。

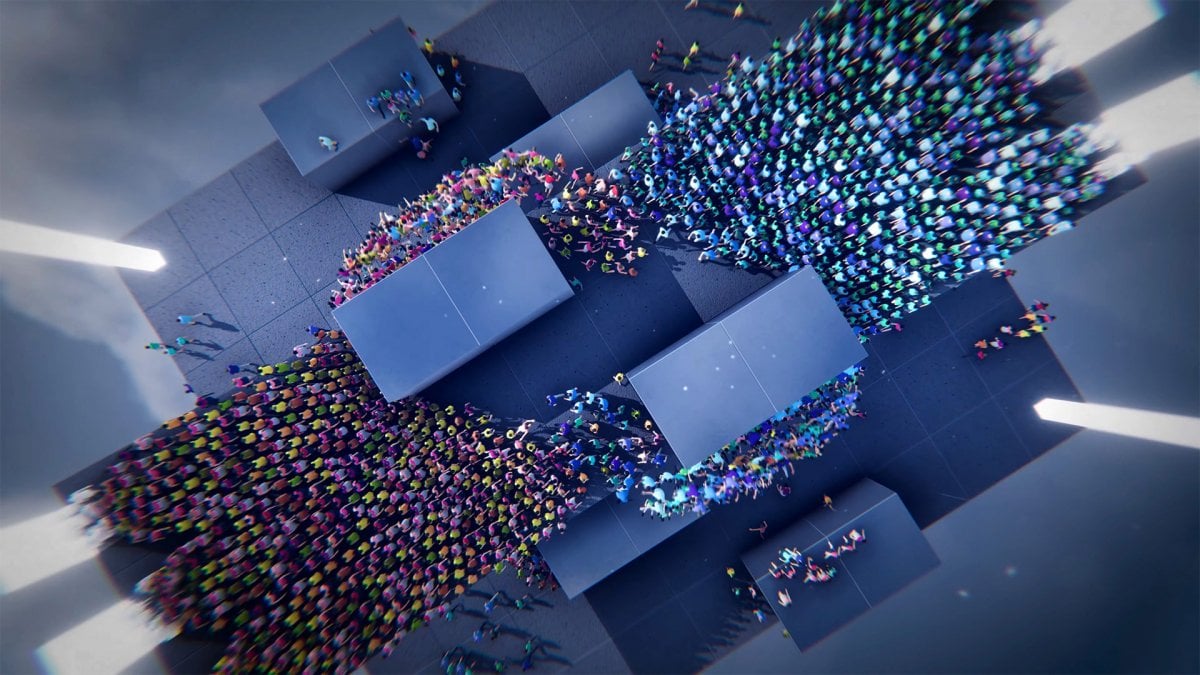

IAとGoogle

コメントのリクエストに応じて、会社はTechCrunch新聞に報告しました新しい投稿「責任」に特化したブログで。部分的には、「これらの価値を共有する企業、政府、および組織が、人々を保護し、世界の成長を促進し、国家安全保障を支援するIを作成するために協力しなければならないと考えています」と読みます。これはすべてよく聞こえますが、IAが武器に使用されないと言うのと同じではありません。

Google Sull'asの新しい更新された原則は、会社が働くことを示しています」意図しない結果または有害な結果を緩和しますそして、「国際法と人権の広く受け入れられている原則」と連携することに加えて、不当な偏見を避けるために。繰り返しますが、このコメントは、元のコメントとまったく同じではありません。

IAはすでに軍事分野で使用されていますたとえば、米国では、国防総省はIAを使用して脅威を特定、追跡、評価する際に「重要な利点」を獲得しています。 、Radha Plumb博士。

「明らかに、私たちはキルチェーンの実行を加速する方法を増やしているので、司令官は私たちの力を保護するために適切なタイミングで対応できるようにします」とPlumb氏は言いました。用語 "チェーンを殺します「これは、センサー、プラットフォーム、武器の複雑なシステムを含む脅威の識別、追跡、排除の軍事プロセスを指します。Plumbによると、生成人工知能は、キルチェーンの計画と戦略段階で有用であることが証明されています。

Googleは持っていますアメリカとイスラエルの軍事部門との契約同社の従業員の内部抗議から生まれたクラウドサービスの提供のために、しかし、IAは人々を傷つけるために使用されていないと言い続けました。その間にEUは現在、この行為に真剣に取り組んでいます:人工知能に関する規則に適応しない人々へのおいしい罰金。